新系统亮相:洞悉模型内在机制,审查其安全性

IT之家7月25日消息,麻省理工学院计算机科学与人工智能实验室的研究人员开发了一种名为“MAIA”的多模式自动化可解释性代理系统,该系统可以使用视觉语言模型来自动执行各种神经网络可解释性任务。

麻省理工学院(MIT)计算机科学与人工智能实验室(CSAIL)最新研发了名为MAIA系统,可以使用视觉语言模型来自动执行各种神经网络可解释性任务。

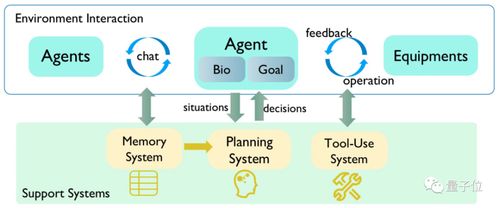

MAIA的全称是MultimodalAutomatedInterpretabilityAgent,直译过来为“多模态自动可解释性代理”,主要利用视觉语言模型,新系统亮相:洞悉模型内在机制,审查其安全性自动执行各种神经网络可解释性任务,并配备了在其他人工智能系统上进行实验的工具。

研究论文的共同作者,来自MITCSAIL的博士后TamarRottShaham表示:

我们的目标是创建一个能够自主进行可解释性实验的人工智能研究人员。现有的自动可解释性方法只是在一次性过程中对数据进行标注或可视化。

另一方面,MAIA可以生成假设,设计实验对其进行测试,并通过迭代分析完善自己的理解。

通过结合预先训练好的视觉语言模型与可解释性工具库,我们的多模态方法可以在特定模型上组成和运行有针对性地实验,来响应用户的询问,不断完善其方法,直至能够提供全面的答案。

该自动代理被证明能够完成三项关键任务:

可以为视觉模型内部的各个组件贴标签,并描述激活这些组件的视觉概念

可以通过去除无关特征来清理图像分类器,使其对新情况更加稳健

还可以寻找人工智能系统中隐藏的偏差,帮助发现其输出中潜在的公平性问题。

MAIA可以通过生成假设、设计实验来测试假设,并通过迭代分析改进其理解,从而解释人工智能模型的内部机制,帮助我们了解人工智能模型如何运作,并探究其安全性和偏差。

IT之家附上参考地址

版权声明

本文仅代表作者观点,不代表百度立场。

本文系作者授权百度百家发表,未经许可,不得转载。